Les missions du poste

Nous recherchons un·e Ingénieur·e Data passionné·e par la conception de plateformes data robustes et scalables. Vous interviendrez sur des projets à fort enjeu métier, en collaboration étroite avec les équipes Data, BI et IT.

🎯 Vos missions :

- Concevoir, développer et maintenir des pipelines de données fiables et performants

- Mettre en place et orchestrer des traitements de données via Apache Airflow

- Développer et optimiser des processus ETL / ELT

- Exploiter et modéliser les données dans des environnements Cloud (GCP, AWS)

- Travailler avec des bases analytiques telles que BigQuery et Snowflake

- Garantir la qualité, la performance et la sécurité des données

- Collaborer avec les équipes BI pour l'exploitation des données (ex : Power BI)

- Participer aux choix d'architecture et aux bonnes pratiques Data

Le profil recherché

🧠 Profil recherché :

- Formation Bac +5 (école d'ingénieur ou équivalent universitaire)

- Minimum 5 ans d'expérience en tant qu'Ingénieur·e Data

- Excellente maîtrise du SQL

- Solide expérience sur les technologies suivantes :

- Apache (écosystème Big Data)

- Airflow

- Hadoop

- Snowflake

- GCP (BigQuery) et/ou AWS

- ETL

- Python et Scala

- Power BI

- Bonne compréhension des architectures Data distribuées

- Esprit d'analyse, autonomie et capacité à travailler en équipe

✅ Atouts appréciés :

- Expérience en environnement Cloud multi-provider

- Sensibilité aux problématiques de gouvernance et de qualité des données

- Culture DevOps / DataOps

Infos complémentaires

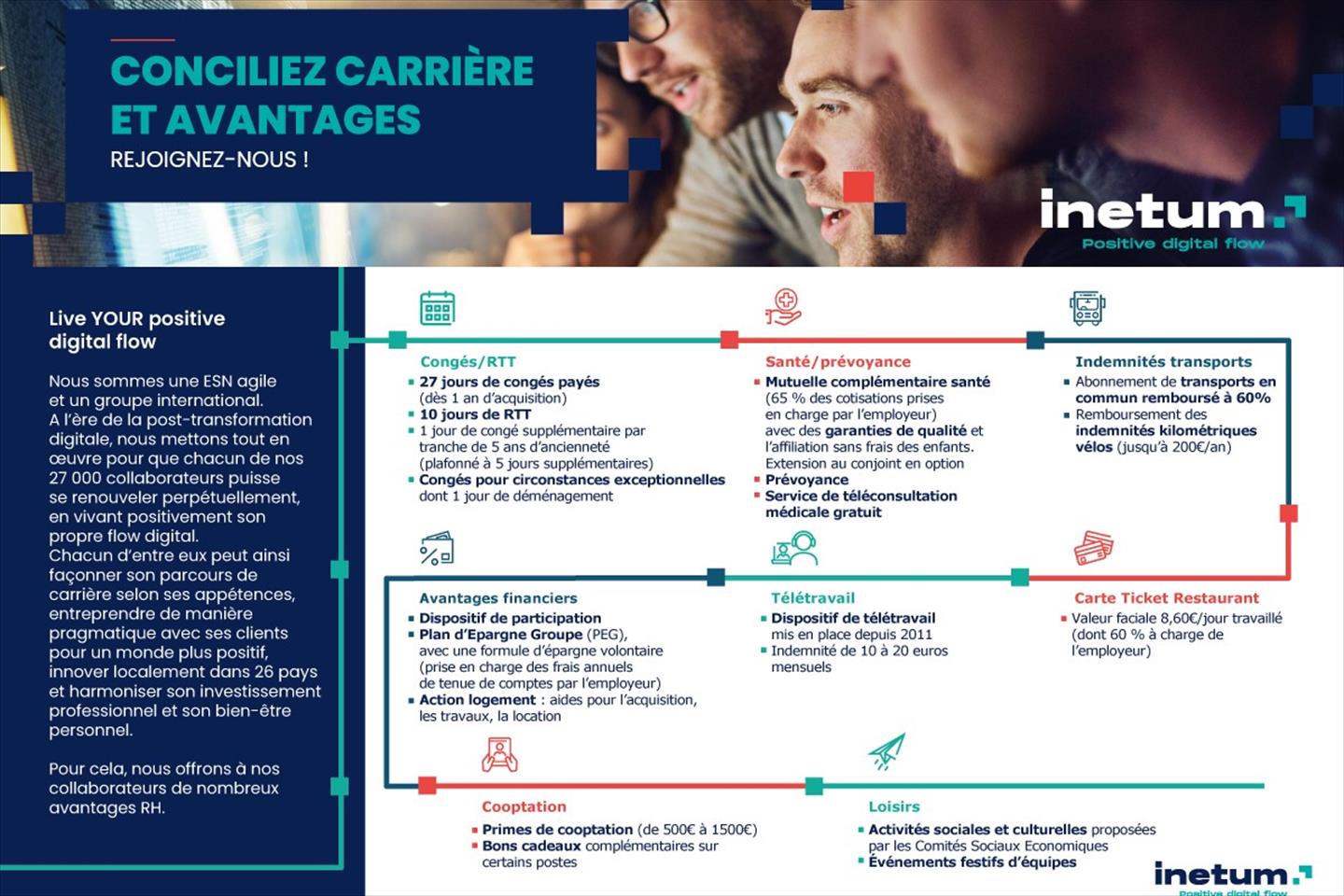

💼 Pourquoi nous rejoindre ?

- Projets innovants à forte valeur ajoutée

- Stack technique moderne et évolutive

- Environnement agile, collaboratif et bienveillant

- Possibilités d'évolution et de montée en compétences

- Télétravail possible

- Rémunération attractive selon profil et expérience

Inetum en images

Publiée le 29/04/2026 - Réf : SYNCSF-fr-20260427-144857